专业唇语阅读者识别唇语的准确率只有20%到60%。人类在日常说话过程中嘴唇的微小移动很难被可靠地解读,尤其是在有一定距离,或画面不清晰的情况下。不过,唇语并不只是美剧《海军罪案调查科》中的噱头,对全球的失聪者来说,这是一项有用的工具。如果能可靠地解读,那么将给数百万人带来帮助。

牛津大学的最新研究描述了一种名为LipNet的人工智能系统。通过“观看”人类说话的视频,以及输入相应文字,这一软件对唇语的解读准确率高达93.4%。这项研究得到了谷歌(微博)旗下DeepMind的资助。

此前最佳的唇语解读工具只能实现逐个单词的解读,准确率只有79.6%。牛津大学研究员表示,新系统获得成功的关键在于通过不同方式去思考这一问题。这一系统不再利用可视元素,即说话者嘴型的变化去训练人工智能,而是每次都处理一整个句子。这使得人工智能可以学会单词对应于什么样的嘴型变化。

为了训练这一系统,研究员向人工智能展示了2.9万条带文字标签的视频,每段视频长度为3秒。而为了观察专业唇语阅读者做得如何,该团队还邀请了“牛津学生残疾人社团”的3名成员,用300条随机视频去进行类似的测试。这些专家的平均错误率为47.7%,而人工智能的错误率只有6.6%。

尽管这一项目取得了成功,但也暴露出了当代人工智能研究的局限。在指导人工智能如何阅读唇语的过程中,牛津大学团队使用了经过设计的视频。视频中的所有人物都面向前方,光线明亮,说出标准结构的语句。

视频中的典型语句时长为3秒钟,例如:“Place blue in m 1 soon。”这其中包括命令、颜色、介词、字母、数字,以及副词。所有语句都采用这样的模式。因此,人工智能的超高准确率只是在一种极端情况下取得的。如果要求人工智能从随机的YouTube视频中阅读唇语,那么结果可能很不准确。

有其他研究人员指出,利用这种特殊视频去训练并不符合真实世界场景。不过,论文作者南多·德弗雷塔斯(Nando de Freitas)为自己的成果进行了辩护。他指出,该团队曾尝试过其他视频,但这些视频带来了太多“噪音”。这些视频各不相同,因此人工智能无法取得有意义的结论。这也意味着,完美的数据集可能并不存在。德弗雷塔斯认为,考虑到这一人工智能的准确率,最终情况如何将取决于任务本身。

OpenAI的杰克·克拉克(Jack Clark)表示,如果希望在现实世界中得到应用,那么这一人工智能还需要三方面的优化:人们在现实世界场景中大量的说话视频;让人工智能可以从多个不同角度去阅读唇语;以及让人工智能可预测的短语类型更多样化。

克拉克表示:“这项技术具备显而易见的应用,但这看起来似乎并不可能。”如果人工智能可以学会阅读唇语,那么将适用于多种场景。此类系统可以被用于帮助听力障碍人士了解周围发生的对话,或是让其他人工智能更好地辨别视频中的声音,生成准确的字幕。

来源:腾讯科技 作者:编译:陈桦

为你推荐

资讯

资讯 第28个世界哮喘日:儿童哮喘早识别、规范治疗,守护患儿健康呼吸

进入5月,气温波动、花粉增多、呼吸道病毒活跃,哮喘也随之进入急性发作的高峰期。今年5月5日,恰逢第28个“世界哮喘日”——以“确保每位

2026-05-05 20:33

资讯

资讯 康方生物授权的Summit美股大跌

2025年4月30日,美股上市公司Summit Therapeutics对外公布截至 2026 年 3 月 31 日第一季度财务业绩及业务进展,其中最受关注的无疑是从康方生物(09926 HK)获得授权的...

2026-05-05 20:02

资讯

资讯 对比,生物医学新技术临床转化应用审批工作规范征求意见稿与正式稿有哪些不同?

4月30日,国家卫健委官网正式发布《生物医学新技术临床转化应用审批工作规范(试行)》,与4月19日发布的征求意见稿有哪些变化?

2026-05-05 10:58

资讯

资讯 生物医学新技术与药品、医疗器械的界定

4月30日,国家卫健委官网发布《生物医学新技术与药品、医疗器械界定指导原则(暂行)》。对于生物医学新技术与药品、医疗器械的操作边界进行指导。

2026-05-05 10:51

资讯

资讯 又一家药企被取消国家药品集采中选资格

4月30日,国家组织药品联合采购办公室发布公告,取消哈尔滨力强药业有限责任公司洛索洛芬钠凝胶贴膏中选资格并将该企业列入违规名单。

2026-04-30 15:19

资讯

资讯 国家药监局原副局长陈时飞被判14年

4月29日,上海市第二中级人民法院一审公开宣判国家药品监督管理局原党组成员、副局长陈时飞受贿案,对被告人陈时飞以受贿罪判处有期徒刑14年,并处罚金人民币400万元;扣押在案...

2026-04-30 10:08

资讯

资讯 微滔生物完成超 5000 万美元 A 轮、A + 轮融资,专注体内 CAR-T 细胞疗法赛道

本轮融资由正心谷资本与德诚资本分别领投,OrbiMed(奥博资本)、汉康资本、卫材创新风投基金、建发新兴投资等知名机构跟投,老股东启明创投、顺禧资本、杏泽资本持续加码

2026-04-29 13:21

资讯

资讯 “A to H 18A第一股”诞生!迈威生物正式登陆香港联交所主板

2026年4月28日,迈威(上海)生物科技股份有限公司(以下简称“迈威生物”,A股代码:688062 SH,港股代码:02493 HK)在香港联合交易所主板正式挂牌上市,成为首家“A to H”的18A上市公司。

2026-04-28 19:22

资讯

资讯 全面接轨国际,药物临床试验质量管理规范再升级

根据国家药监局发布的2025年第125号公告,自2026年3月31日后实施的药物临床试验,均适用《E6(R3):药物临床试验质量管理规范技术指导原则》(下称 ICH E6(R3))。

2026-04-28 19:13

资讯

资讯 百济神州引入PD-1/CTLA-4/VEGF-A三抗

4月28日,百济神州发布公告称,2026年4 月 24 日,百济神州有限公司的全资子公司广州百济神州生物制药有限公司与华辉安健(北京)生物科技有限公司签订了一份《独家选择权、...

2026-04-28 09:49

资讯

资讯 药品附条件批准上市申请审评审批工作程序

附条件批准时,每个附条件批准的适应症单独设置药品注册证书有效期,原则上,在确证性研究完成时限的基础上增加一年。确证性研究完成时限由药审中心在审评中与申请人沟通交流后...

2026-04-26 10:58

资讯

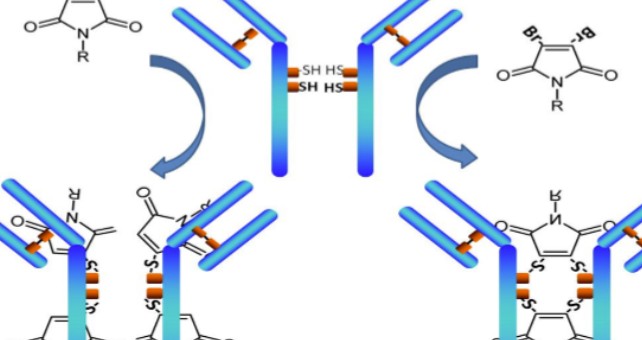

资讯 CDE:抗体偶联药物首次申报临床试验药学资料撰写指导原则

本指导原则基于 ICH M4Q( R1)总体框架, 格式体例与之保持一致, 在其框架下结合抗体偶联药物的药学研究特点,细化了 IND 申报药学资料的撰写要求,旨在为该类药物 IN...

2026-04-25 21:39

资讯

资讯 蚂蚁健康向医院开放“智慧医疗AI一体化方案” 支持智能体、云陪诊、本地化模型部署

4月25日,在2026中国医院信息网络大会(CHIMA 2026)上,蚂蚁健康面向全国医院及医疗机构推出“智慧医疗AI一体化方案”。

2026-04-25 20:09

资讯

资讯 美敦力 5.5 亿美元收购 Scientia Vascular,加码神经血管赛道布局

Scientia Vascular 是专注于神经血管创新器械研发的新兴企业,核心产品管线聚焦颅内血管病变介入治疗领域

2026-04-25 15:50

资讯

资讯 聚焦预防接种全龄升级,多方合力开展“成人全周期免疫促进暨带状疱疹公益科普”

4月25日,国家疾病预防控制局在上海举办主题宣传活动,呼吁“预防接种,苗助健康,全民行动”。

2026-04-25 15:41